앤스로픽의 Mythos 제한 비난 후, OpenAI도 사이버 접근 제한

(techcrunch.com)

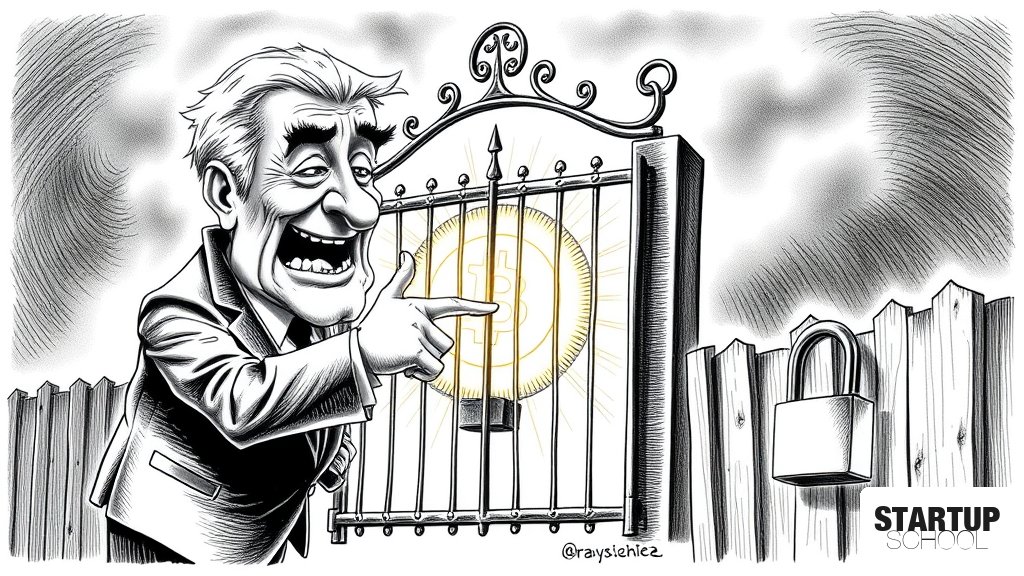

OpenAI가 자사의 새로운 사이버 보안 도구인 'Cyber'의 접근 권한을 특정 보안 전문가로 제한하기로 결정했습니다. 이는 과거 앤스로픽(Anthropic)의 유사한 조치를 '공포 마케팅'이라 비판했던 샘 알트만의 입장과 상반되는 행보로, AI 기술의 오남용 방지를 위한 업계의 움직임을 보여줍니다.

이 글의 핵심 포인트

- 1OpenAI, GPT-5.5 Cyber의 접근 권한을 '핵심 사이버 방어자'로 제한 발표

- 2Cyber 도구는 침투 테스트, 취약점 식별, 악성코드 역공학 기능 포함

- 3샘 알트만, 과거 앤스로픽의 Mythos 제한을 '공포 마케팅'이라 비판했으나 동일한 행보 채택

- 4악의적인 사용자를 방지하기 위해 미국 정부와 협력하여 사용자 자격 검증 진행

- 5Anthropic의 Mythos 역시 비인가 그룹에 의해 접근 권한이 뚫린 사례 존재

이 글에 대한 공공지능 분석

왜 중요한가

AI 모델의 능력이 단순 텍스트 생성을 넘어 침투 테스트, 취약점 공격 등 실질적인 사이버 공격이 가능한 수준으로 진화했음을 의미합니다. 기술의 강력한 성능이 곧 강력한 위협이 될 수 있다는 '이중 용도(Dual-use)'의 딜레마가 본격화되었습니다.

배경과 맥락

최근 AI 에이전트 기술이 발전하며 사이버 보안, 코드 실행 등 고도의 전문성을 요구하는 작업이 가능해졌습니다. OpenAI는 GPT-5.5 Cyber를 출시하며 보안 위협을 방지하기 위해 미국 정부와 협력하여 검증된 사용자에게만 권한을 부여하는 '게이트키로잉(Gatekeeping)' 전략을 채택했습니다.

업계 영향

주요 AI 기업들이 기술 공개 범위를 조절하는 '폐쇄적 배포' 모델을 채택함에 따라, AI 모델의 성능 격차보다 '접근 권한'이 새로운 경쟁 요소로 부상할 수 있습니다. 이는 보안 솔루션 시장에서 AI 모델 자체의 성능만큼이나 '안전한 사용 환경(Sandboxing)' 구축이 중요해짐을 시사합니다.

한국 시장 시사점

글로벌 빅테크가 보안을 이유로 핵심 기능을 제한함에 따라, 한국의 보안 스타트업들은 거대 모델의 기능을 모방하기보다, 이러한 제한된 도구들을 안전하게 관리하고 모니터링하는 'AI 거버넌스' 및 'AI 보안 관제' 영역에서 틈새시장을 찾을 수 있습니다.

이 글에 대한 큐레이터 의견

샘 알트만의 이번 결정은 AI 산업의 패러다임이 '무한한 확장'에서 '책임 있는 통제'로 급격히 이동하고 있음을 보여주는 상징적인 사건입니다. 앤스로픽의 전략을 비판했던 OpenAI가 결국 같은 길을 선택한 것은, 규제 당국의 압박과 사회적 책임이라는 거대한 파도를 피할 수 없음을 자인한 셈입니다. 창업자들은 이를 단순한 '기술 제한'이 아닌, '규제 기반의 시장 재편'으로 읽어야 합니다.

스타트업 창업자들에게는 위기이자 기회입니다. OpenAI나 Anthropic 같은 거대 기업이 '공격형 AI(Cyber, Mythos)'의 접근을 제한할수록, 그 도구들이 가져올 수 있는 보안 허점을 메우는 '방어형 AI' 및 '컴플라이언스 자동화' 솔루션의 가치는 폭등할 것입니다. 거대 모델의 기능을 따라잡으려 하기보다, 그 모델들이 안전하게 작동할 수 있도록 검증하고 감시하는 '신뢰 레이어(Trust Layer)' 구축에 집중하는 전략이 유효할 것입니다.

관련 뉴스

댓글

아직 댓글이 없습니다. 첫 댓글을 남겨보세요.