AI CLI 오케스트레이터, tasuki: 툴 간의 매끄러운 연동을 지원

(dev.to)

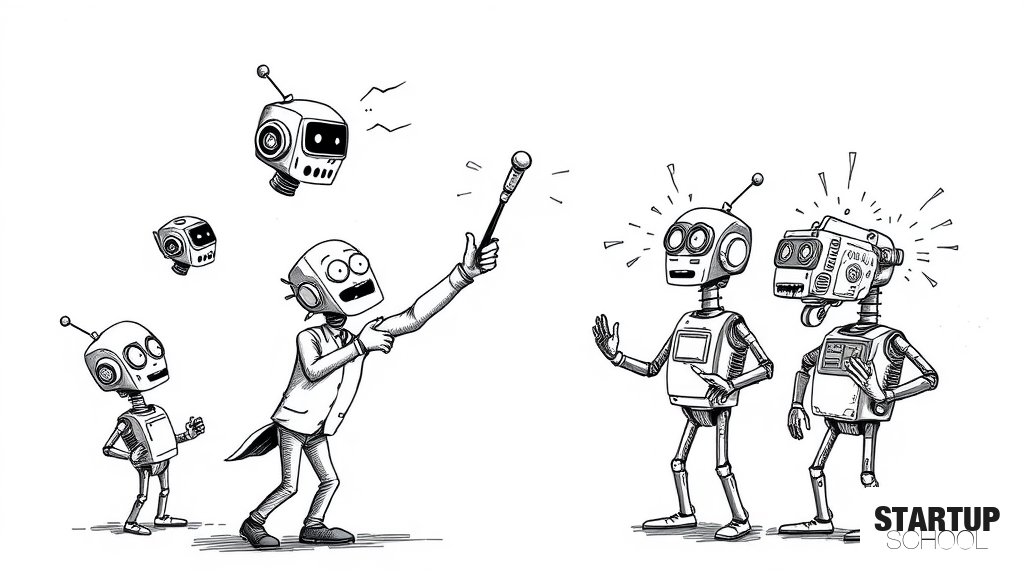

tasuki는 Claude Code, Codex CLI, GitHub Copilot CLI 등 다양한 AI CLI 도구 간의 전환을 자동화하는 AI CLI 오케스트레이터입니다. 각 도구의 사용량 제한(Rate Limit)에 도달했을 때, 작업 컨텍스트를 유지하며 우선순위에 따라 다음 도구로 매끄럽게 핸드오프하여 개발자의 워크플로우 중단을 방지합니다.

이 글의 핵심 포인트

- 1Claude Code, Codex CLI, GitHub Copilot CLI 간의 자동 전환 지원

- 2사용량 임계값(기본 95%) 도달 시 자동으로 다음 우선순위 모델로 핸드오프

- 3.tasuki/handoff.md 파일을 통한 작업 컨텍스트(Context) 및 진행 상황 유지

- 4PTY(Pseudo Terminal) 래핑을 통해 기존 CLI의 인터랙티브 UI 경험을 그대로 보존

- 5단기 갱신 모델(Claude/Codex)을 우선 소진하고 월간 쿼터 모델(Copilot)을 브릿지로 활용하는 비용 최적화 전략

이 글에 대한 공공지능 분석

왜 중요한가

AI 모델의 발전 속도가 빨라짐에 따라 개발자들은 단일 모델에 의존하기보다 각 모델의 강점을 활용하기 위해 멀티 모델을 사용하고 있습니다. tasuki는 이 과정에서 발생하는 '도구 전환 비용(Context Switching Cost)'과 '사용량 제한 관리'라는 실질적인 페인 포인트를 자동화로 해결했다는 점에서 중요합니다.

배경과 맥락

현재 AI 도구 시장은 월간 구독형(Copilot)과 짧은 갱신 주기를 가진 모델(Claude/Codex)이 혼재되어 있습니다. 개발자들은 비용 효율성을 위해 여러 도구를 구독하지만, 각 도구의 쿼터(Quota)가 소진될 때마다 수동으로 도구를 교체해야 하는 번거로움과 작업 흐름의 단절을 겪고 있습니다.

업계 영향

이 기술은 AI 에이전트 생태계가 '개별 도구' 중심에서 '오케스트레이션 레이어' 중심으로 이동할 수 있음을 시사합니다. 특정 모델에 종속되지 않고 여러 모델의 기능을 유기적으로 결합하는 미들웨어 기술의 중요성이 커질 것이며, 이는 AI 에이전트 간의 상호운용성(Interoperability) 표준 논의로 이어질 수 있습니다.

한국 시장 시사점

한국의 개발자 및 스타트업은 높은 생산성을 지향하며 최신 기술 도입에 매우 민감합니다. tasuki와 같은 오픈소스 오케스트레이션 도구의 등장은 국내 기업들이 특정 빅테크의 AI 생태계에 종속되지 않고, 비용 효율적이면서도 강력한 멀티 LLM 워크플로우를 구축할 수 있는 기술적 토대를 제공합니다.

이 글에 대한 큐레이터 의견

스타트업 창업자 관점에서 tasuki는 'AI 에이전트의 파편화'라는 문제를 '오케스트레이션'이라는 기회로 전환한 사례입니다. 현재 AI 시장은 각 모델이 독자적인 생태계를 구축하려 하지만, 실제 사용자(개발자)는 비용과 성능의 최적점을 찾기 위해 여러 모델을 동시에 사용합니다. 이 지점에서 개별 모델의 성능을 극대화하면서도 사용자의 불편함을 제거하는 '연결자(Connector)' 역할의 소프트웨어가 강력한 니치 마켓을 형성할 것입니다.

실행 가능한 인사이트를 드리자면, 향후 AI 기반 서비스를 구축할 때 단일 모델의 API에 의존하기보다, 모델 간의 컨텍스트 전환과 상태 유지를 관리하는 '워크플로우 관리 레이어'를 설계 단계부터 고려해야 합니다. tasuki가 보여준 `.tasuki/handoff.md`와 같은 컨텍스트 유지 방식은, 모델이 바뀌어도 작업의 연속성을 보장하는 에이전틱 워크플로우(Agentic Workflow)의 핵심 요소가 될 것입니다.

관련 뉴스

댓글

아직 댓글이 없습니다. 첫 댓글을 남겨보세요.