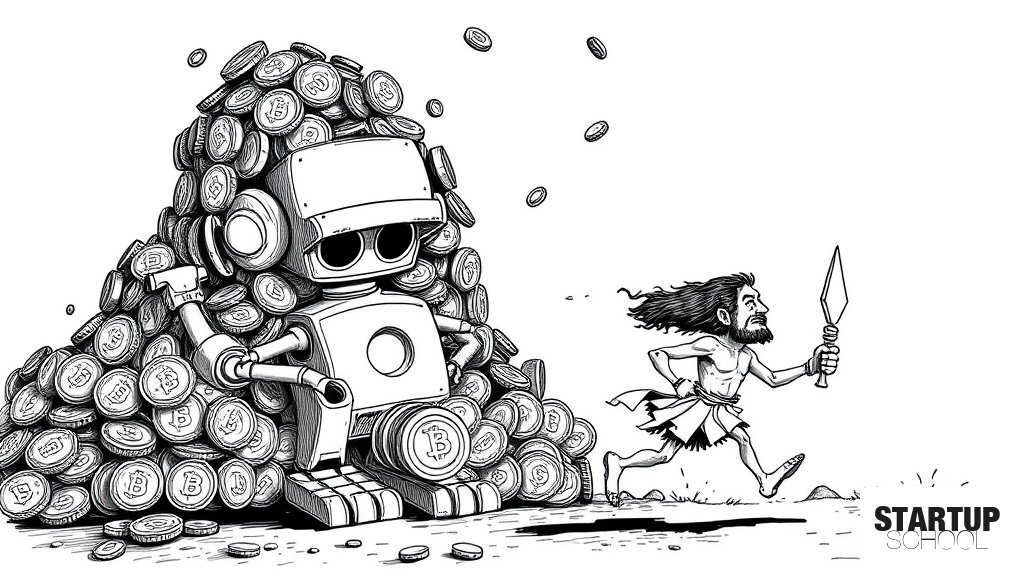

원시인: 적은 token으로도 충분한데, 왜 많은 token을 쓰는가?

(github.com)

'케이브맨(Caveman)' 플러그인은 LLM(특히 Claude)의 출력 토큰 사용량을 평균 65%(최대 87%) 획기적으로 절감하면서도 기술적 정확도를 100% 유지합니다. 간결한 '원시인 말투'를 사용하여 응답 속도를 3배 높이고 가독성을 개선하며, 간결함이 LLM 성능을 향상시킨다는 연구 결과에 기반합니다.

이 글의 핵심 포인트

- 1'케이브맨' 플러그인은 LLM 출력 토큰 사용량을 평균 65%, 최대 87%까지 절감하여 비용 효율성을 극대화합니다.

- 2기술적 정확도를 100% 유지하면서도, 응답 속도를 약 3배 향상시키고 간결한 표현으로 가독성을 높입니다.

- 32026년 3월 연구에 따르면, 간결한 응답 제약이 LLM의 정확도를 특정 벤치마크에서 26%p 개선하는 것으로 나타났습니다.

- 4불필요한 인사말, 완곡어법, 관사 등 '필러(filler)' 단어와 구문을 제거하지만, 코드 블록, 기술 용어, 에러 메시지는 원본 그대로 유지합니다.

- 5이 플러그인은 LLM의 '생각/추론' 과정에는 영향을 주지 않고 '출력' 토큰에만 영향을 미쳐, 뇌는 작아지지 않고 입만 작아진다고 강조합니다.

이 글에 대한 공공지능 분석

왜 중요한가

배경과 맥락

업계 영향

한국 시장 시사점

이 글에 대한 큐레이터 의견

이 '케이브맨' 플러그인은 단순히 재밌는 아이디어를 넘어, LLM 기반 서비스를 운영하는 스타트업들에게 매우 실질적인 해답을 제시합니다. 많은 스타트업이 LLM의 잠재력에 매료되어 서비스를 출시하지만, 사용량 증가에 따른 API 비용 폭탄과 응답 지연은 곧 현실적인 벽에 부딪히게 만듭니다. '케이브맨'은 이 두 가지 핵심 문제를 동시에 해결하는 효과적인 방법론을 제시하며, 특히 간결함이 정확도를 높인다는 과학적 근거는 '정답은 복잡하지 않다'는 통찰을 줍니다. 이는 스타트업들이 LLM 활용 전략을 재고하고, 불필요한 '말' 대신 '본질'에 집중하는 서비스 설계로 전환할 수 있는 중요한 계기가 될 것입니다.

관련 뉴스

댓글

아직 댓글이 없습니다. 첫 댓글을 남겨보세요.