시, AI와 API를 활용해 Flock 카메라 접근성 시연, 어린이 체조 교실에서 판매 데모 진행

(404media.co)

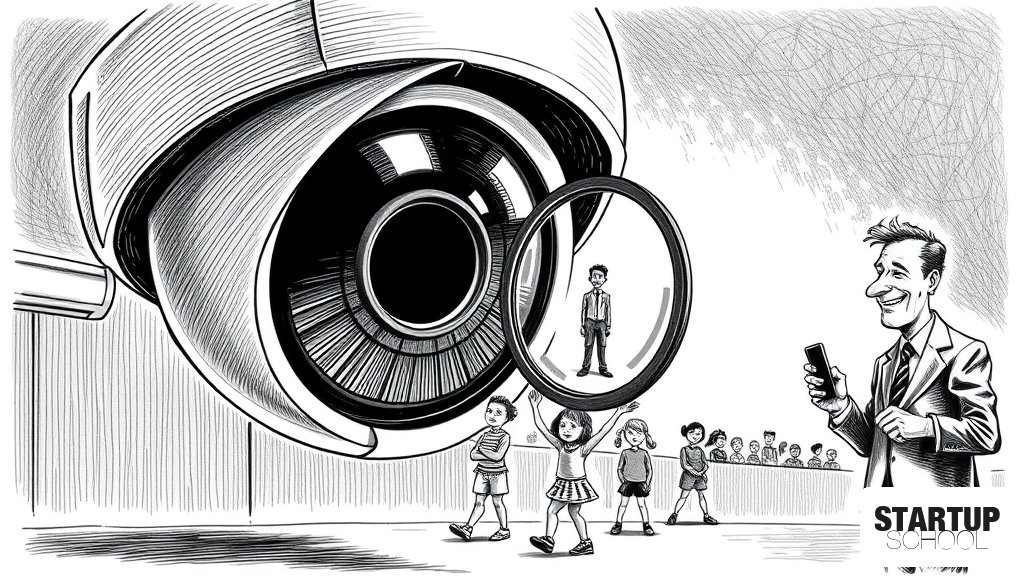

미국의 보안 기술 기업 Flock Safety가 판매 데모를 위해 어린이 체조 교실, 수영장 등 민감한 장소의 카메라에 접근했다는 사실이 밝혀져 큰 논란이 되고 있습니다. Flock 측은 시 당국의 허가를 받은 정당한 제품 시연이었다고 주장하지만, 개인정보 침해 및 감시 논란이 거세지며 결국 해당 장소에서의 데모를 중단하기로 했습니다.

이 글의 핵심 포인트

- 1Flock Safety가 판매 데모를 위해 어린이 체조 교실, 수영장 등 민감한 장소의 카메라에 접근함

- 2해당 접근은 시 당국의 '데모 파트너 프로그램'을 통해 허가된 것이었으나 사회적 비난을 초래함

- 3공공 기록 요청을 통해 확보된 접근 로그가 이번 사건의 결정적 증거가 됨

- 4Flock 측은 '투명성'을 주장하며 스파이 행위 의혹을 부인했으나, 결국 민감 장소에서의 데모 중단을 결정함

- 5보안 기술의 확장이 민간 소유 카메라 네트워크까지 포함하면서 감시 범위 확대에 대한 우려가 커짐

이 글에 대한 공공지능 분석

왜 중요한가

AI 및 보안 기술 스타트업이 제품의 성능을 증명하기 위해 실제 데이터를 활용하는 과정에서 발생할 수 있는 윤리적·법적 경계선을 보여주는 사례입니다. 기술적 우수성만큼이나 '데이터 활용의 윤리성'이 기업의 생존을 결정짓는 핵심 요소임을 시사합니다.

배경과 맥antum

최근 AI 기반의 실시간 범죄 대응 센터(RTCC)와 지능형 CCTV 도입이 전 세계적으로 확산되면서, 공공과 민간의 카메라 네트워크를 통합하려는 시도가 늘고 있습니다. 이 과정에서 판매를 위한 '실제 환경 테스트(Real-world testing)'와 개인의 '프라이버시 보호' 사이의 충돌이 심화되고 있습니다.

업계 영향

B2G(정부 대상) 및 B2B 보안 솔루션 기업들에게 데모 방식에 대한 엄격한 가이드라인이 요구될 것입니다. 실제 민감한 데이터 대신 합성 데이터(Synthetic Data)나 비식별화된 데이터를 활용한 시연 기술이 차별화된 경쟁력이 될 가능성이 높습니다.

한국 시장 시사점

CCTV 밀도가 매우 높은 한국 시장에서는 개인정보보호법(PIPA) 준수가 매우 엄격합니다. AI 비전 스타트업들은 기술 개발 단계부터 'Privacy by Design(설계에 의한 개인정보 보호)'을 적용하여, 데이터 접근 권한 관리와 비식별화 기술을 제품의 핵심 기능으로 내세워야 합니다.

이 글에 대한 큐레이터 의견

스타트업 창업자들에게 이번 사건은 '제품의 성능 증명'과 '사회적 신뢰 확보' 사이의 치명적인 트레이드오프(Trade-off)를 경고합니다. Flock Safety는 기술적 투명성(Access Log 공개)을 강조하며 방어에 나섰지만, 대중은 '무엇을 할 수 있는가'보다 '무엇을 하지 않는가'에 더 민감하게 반응했습니다. 판매를 위한 데모가 자칫 기업의 브랜드 가치를 한순간에 파괴하는 '독'이 될 수 있음을 명심해야 합니다.

따라서 AI 보안 스타트업은 '우리는 모든 것을 볼 수 있다'는 식의 강력한 성능 과시보다는, '우리는 개인을 식별하지 않고도 위협을 탐지할 수 있다'는 식의 '프라이버시 보존형 기술(Privacy-Preserving Tech)'을 비즈니스 모델의 핵심 가치로 삼아야 합니다. 합성 데이터 생성 기술이나 엣지 컴퓨팅을 통한 현장 즉시 비식별화 기술은 단순한 부가 기능이 아니라, 글로벌 시장 진출을 위한 필수적인 '윤리적 해자(Ethical Moat)'가 될 것입니다.

관련 뉴스

댓글

아직 댓글이 없습니다. 첫 댓글을 남겨보세요.