클래리페이, 얼굴 인식 AI 학습을 위해 OkCupid가 제공한 300만 장의 사진 삭제, 보고서 발표

(techcrunch.com)

AI 플랫폼 Clarifai가 얼굴 인식 AI 학습을 위해 OkCupid로부터 무단으로 사용한 사진 300만 장과 해당 데이터를 사용해 학습된 모델을 전량 삭제했습니다. FTC(미 연방거래위원회) 조사 결과, 이 과정에서 사용자의 개인정보 보호 정책 위반 및 데이터 수집 과정의 기만적 행위가 드러나며 양사가 합의에 도달했습니다.

이 글의 핵심 포인트

- 1Clarifai, OkCupid로부터 수집한 사진 300만 장 및 관련 학습 모델 전량 삭제

- 22014년 당시 데이터 수집 과정에서 OkCupid의 개인정보 보호 정책 위반 확인

- 3FTC 조사 결과, 데이터 수집 및 공유 과정에서의 기만적 행위 및 은폐 시도 적발

- 4Match Group과 OkCupid는 향후 데이터 수집 방식에 대한 허위 표시 금지 명령 수용

- 5데이터 출처의 불투명성이 초래하는 '알고리즘 폐기'의 치명적 리스크 시사

이 글에 대한 공공지능 분석

왜 중요한가

AI 모델의 성능을 결정짓는 '양질의 데이터' 확보 과정에서 발생하는 윤리적, 법적 리스크가 기업의 핵심 자산인 알고리즘 자체를 파괴할 수 있음을 보여주는 사례입니다. 데이터의 출처(Provenance)가 불분명할 경우, 공들여 만든 모델 전체를 폐기해야 하는 '알고리즘 폐기(Algorithmic Disgorgement)'의 실질적 위협을 경고합니다.

배경과 맥락

컴퓨터 비전 및 얼굴 인식 기술의 발전 과정에서 대규모 데이터셋 확보는 필수적이었으며, Clarifai는 이를 위해 OkCupid의 사용자 데이터를 활용했습니다. 하지만 이 과정에서 데이터 제공자와 수집자 간의 불투명한 관계와 사용자 동의 없는 데이터 활용이 법적 분쟁으로 이어졌습니다.

업계 영향

AI 업계 전반에 데이터 거버니스의 중요성을 재확인시켰습니다. 향후 AI 기업들은 데이터 수집 단계부터 저작권 및 개인정보 보호 정책 준수 여부를 검증하는 'Compliance-by-design' 전략을 필수적으로 채택해야 하며, 이는 데이터 확보 비용의 상승으로 이어질 수 있습니다.

한국 시장 시사점

개인정보보호법(PIPA)이 매우 엄격한 한국 시장에서, 데이터 기반 AI 스타트업은 데이터 수집의 적법성을 입증할 수 있는 체계적인 로그와 동의 프로세스를 구축해야 합니다. 기술적 우위보다 데이터의 '깨끗한 출처'가 기업 가치 평가와 글로벌 확장성(Scalability)의 핵심 지표가 될 것입니다.

이 글에 대한 큐레이터 의견

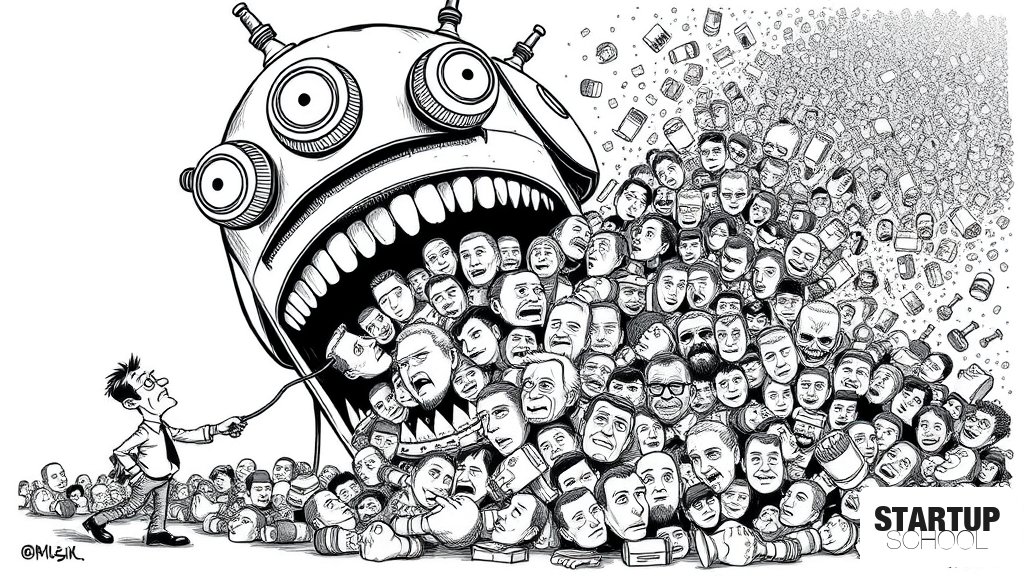

AI 스타트업 창업자들에게 이번 사건은 '데이터의 양보다 중요한 것은 데이터의 권리'라는 뼈아픈 교훈을 줍니다. 12년 전의 과거 데이터라 할지라도, 수집 과정의 위법성이 드러나는 순간 기업이 쌓아온 기술적 성취는 한순간에 '자산'에서 '부채'로 변할 수 있습니다. 특히 모델의 가중치(Weights)까지 삭제해야 하는 상황은 기술 기반 스타트업에 있어 사실상 사형 선고와 다름없습니다.

따라서 창업자들은 데이터 파이프론 구축 초기 단계부터 데이터의 수집 경로, 사용자 동의 범위, 그리고 데이터의 소유권을 명확히 문서화하는 '데이터 계보(Data Lineage)' 관리에 집중해야 합니다. 향후 글로벌 시장 진출이나 대규모 투자 유치를 고려한다면, 데이터 윤리와 컴플라이언스는 단순한 법적 절차가 아닌, 비즈니스의 지속 가능성을 담보하는 핵심적인 기술적 인프라로 다뤄져야 합니다.

관련 뉴스

댓글

아직 댓글이 없습니다. 첫 댓글을 남겨보세요.