퍼널, 오픈소스 프로젝트 프루나 1주년 기념

(dev.to)

AI 모델 최적화 프레임워크인 Pruna가 오픈소스 프로젝트 출시 1주년을 맞이했습니다. Pruna는 복잡한 모델 압축 및 평가 과정을 단순화하여, 개발자가 더 빠르고 저렴하게 고성능 AI 모델을 배포할 수 있도록 돕는 것을 목표로 합니다.

이 글의 핵심 포인트

- 1Pruna 오픈소스 프로젝트 출시 1주년 달성

- 243개의 알고리즘 및 12개의 알고리즘 패밀리 구축 완료

- 3모델 압축, 평가, 최적화를 단 몇 줄의 코드로 구현 가능한 단순성 제공

- 41년간 13회의 릴리스와 28명의 컨트리뷰터 참여를 통한 성장

- 5AI 효율성 교육 및 리소스(AI Efficiency Course)를 통한 생태계 확장

이 글에 대한 공공지능 분석

왜 중요한가

AI 모델의 크기가 거대해짐에 따라 추론 비용과 지연 시간(Latency) 문제가 심화되고 있습니다. Pruna는 이 복잡한 최적화 과정을 자동화하여 AI 모델의 실질적인 상용화 문턱을 낮추는 데 기여합니다.

배경과 맥락

기존의 모델 최적화 방식은 여러 기법을 수동으로 조합하고 튜닝해야 하는 번거로움이 있었습니다. Pruna는 이러한 '최적화의 고통'을 해결하기 위해 통합된 패키지 형태의 오픈소스 솔루션을 제공하며 성장해 왔습니다.

업계 영향

모델 압축 및 평가 프로세스의 표준화는 AI 엔지니어링의 생산성을 극대화합니다. 이는 특히 리소스가 제한된 환경(Edge, Mobile)에서의 AI 실행 가능성을 높여 AI 생애주기 전반의 확장을 가속화할 것입니다.

한국 시장 시사점

GPU 비용 절감이 생존 직결 문제인 한국의 AI 스타트업들에게 Pruna와 같은 도구는 유의미한 비용 구조 개선의 기회를 제공합니다. 모델 최적화 기술을 서비스 파이프라인에 내재화하는 것이 핵심 경쟁력이 될 것입니다.

이 글에 대한 큐레이터 의견

AI 스타트업 창업자에게 '추론 비용(Inference Cost)'은 서비스의 유닛 이코노믹스(Unit Economics)를 결정짓는 가장 치명적인 변수입니다. Pruna와 같은 오픈소스 프레임워크의 발전은 거대 모델을 다루는 기술적 난이도를 낮추어, 적은 자본으로도 고효율의 AI 서비스를 운영할 수 있는 기술적 토대를 마련해 줍니다. 이는 단순히 기술적 편의를 넘어, 수익 구조를 개선할 수 있는 강력한 기회입니다.

따라서 개발 팀은 모델 개발 단계부터 '최적화 가능성'을 고려한 파이프라인을 구축해야 합니다. 모델의 성능(Accuracy)과 효율성(Efficiency) 사이의 트레이드오프를 자동화된 도구로 관리할 수 있다면, 이는 곧 시장 출시 속도(Time-to-Market)와 비용 경쟁력으로 직결될 것입니다. 오픈소스 생태계의 성장을 주시하며 이를 자사 서비스의 인프라 최적화 전략에 적극적으로 통합하는 실행력이 필요합니다.

관련 뉴스

- 100시간 후: 오픈소스 휴머노이드 하드웨어가 실험가들에게 실제로 무엇을 가능하게 하는가

- SuperCmd 출시: Raycast Pro를 대체할 오픈소스 AI 생산성 도구

- 사용자의 67%가 검색 결과 클릭 대신 AI 어시스턴트를 통해 첫 답변을 얻는 시대가 도래함에 따라, 기존 SEO(검색 엔진 최적화)를 넘어 AI 엔진에 인용되기 위한 AEO(답변 엔진 최적화)의 중요성을 강조합니다. 이를 위해 웹사이트의 구조, 스키마, 메타데이터를 최적화하여 ChatGPT나 Perplexity 같은 AI 모델에 잘 노출되도록 돕는 오픈소스 도구 'aeoptimize'를 소개합니다.

- Mercor, 오픈소스 LiteLLM 프로젝트 침해에 따른 사이버 공격 당해

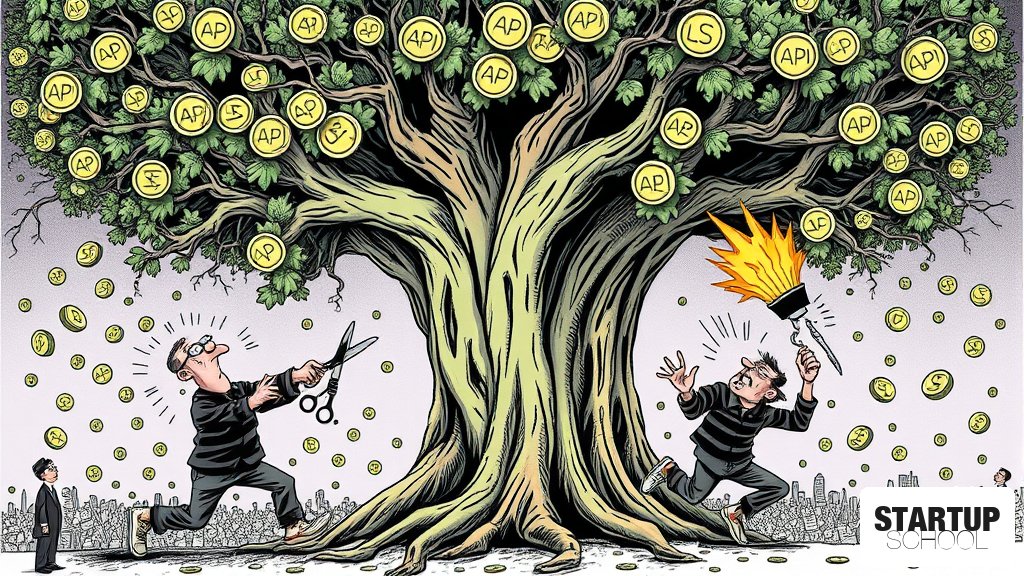

- 플럭 중단: AI, API, GPU 활용 전략 재점검

댓글

아직 댓글이 없습니다. 첫 댓글을 남겨보세요.