$28/월 DigitalOcean GPU Droplet에서 vLLM으로 Mixtral 8x7B 배포하는 방법: Mixture-of-Experts 추론, API 비용의 1/75로

(dev.to)

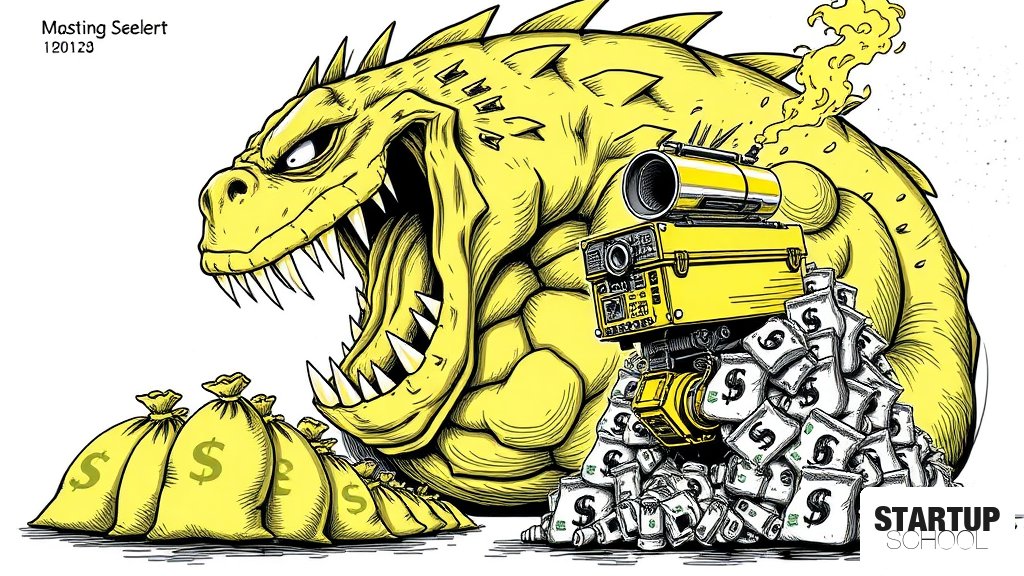

OpenAI나 Claude 같은 고가의 LLM API 대신, DigitalOcean의 저렴한 GPU Droplet과 vLLM 엔진을 활용해 Mixtral 8x7B 모델을 직접 배포함으로써 추론 비용을 최대 1/75 수준으로 절감하는 방법을 소개합니다. 이 방식은 비용뿐만 아니라 지연 시간(Latency)과 데이터 프라이버시 측면에서도 압도적인 우위를 점할 수 있음을 보여줍니다.

이 글의 핵심 포인트

- 1API 대비 최대 1/75 수준의 비용 절감 가능 (5만 건 요청 기준 $2,700 vs $28)

- 2vLLM 엔진의 PagedAttention 및 MoE 최적화를 통한 고성능 추론 구현

- 3기존 API 대비 낮은 지연 시간(120-200ms) 및 데이터 프라이버시 확보

- 4DigitalOcean GPU Droplet(H100/L4)을 활용한 손쉬운 인프라 구축 방법 제시

- 5Mixtral 8x7B 모델의 MoE 구조를 활용한 효율적인 파라미터 활성화

이 글에 대한 공공지능 분석

왜 중요한가

LLM 기반 서비스를 운영하는 스타트업에게 가장 큰 비용 부담은 API 호출 비용입니다. 본 기사는 단순한 비용 절감을 넘어, 고성능 오픈소스 모델(Mixtral)과 효율적인 추론 엔진(vLLM)을 결합해 경제적 자립을 달성할 수 있는 구체적인 기술적 경로를 제시합니다.

배경과 맥락

최근 Mixture-of-Experts(MoE) 구조를 가진 모델들이 등장하며, 모든 파라미터를 활성화하지 않고도 높은 성능을 내는 효율적인 추론이 가능해졌습니다. vLLM은 PagedAttention과 같은 기술을 통해 이러한 모델의 효율성을 극대화하여, 고가의 GPU 인프라에서도 높은 처리량(Throughput)을 보장하는 핵심 기술로 자리 잡고 있습니다.

업계 영향

'API 의존형' 모델에서 '자체 호스팅(Self-hosting) 모델'로의 전환이 가속화될 것입니다. 이는 인프라 운영 능력을 갖춘 기업이 API 비용 경쟁에서 우위를 점할 수 있음을 의미하며, 추론 비용 최적화가 AI 스타트업의 핵심적인 생존 전략(Unit Economics)이 될 것임을 시사합니다.

한국 시장 시사점

글로벌 API 비용 부담이 큰 한국 스타트업들에게 이는 매우 중요한 인사이트입니다. GPU 인프라를 직접 관리하는 DevOps/MLOps 역량이 단순한 운영 능력을 넘어, 서비스의 수익성을 결정짓는 핵심 경쟁력이 될 것입니다.

이 글에 대한 큐레이터 의견

AI 스타트업 창업자들에게 이 기사는 '수익성(Profitability)의 설계도'와 같습니다. 많은 창업자가 제품의 기능(Feature)에 집중할 때, 인프라의 효율성을 고민하는 것은 서비스의 유닛 이코노믹스를 근본적으로 바꾸는 일입니다. API 비용이 매출의 대부분을 잠식하는 구조에서는 아무리 사용자가 늘어나도 적자를 면하기 어렵기 때문입니다.

다만, 주의할 점은 '운영 복잡도'라는 기회비용입니다. 기사에서는 30분 내외의 짧은 설정 시간을 강조하지만, 실제 프로덕션 환경에서는 모델 업데이트, GPU 가용성 관리, 오토스케일링 등 관리 포인트가 늘어납니다. 따라서 초기 프로토타이핑 단계에서는 API를 사용하되, 트래픽이 예측 가능한 시점에는 vLLM과 같은 엔진을 활용한 자체 배포 전략을 단계적으로 도입하는 '하이브리드 전략'이 가장 현실적이고 영리한 접근입니다.

관련 뉴스

댓글

아직 댓글이 없습니다. 첫 댓글을 남겨보세요.