AI 모델을 교체하면서 에이전트 재구축 없이 하는 방법

(dev.to)

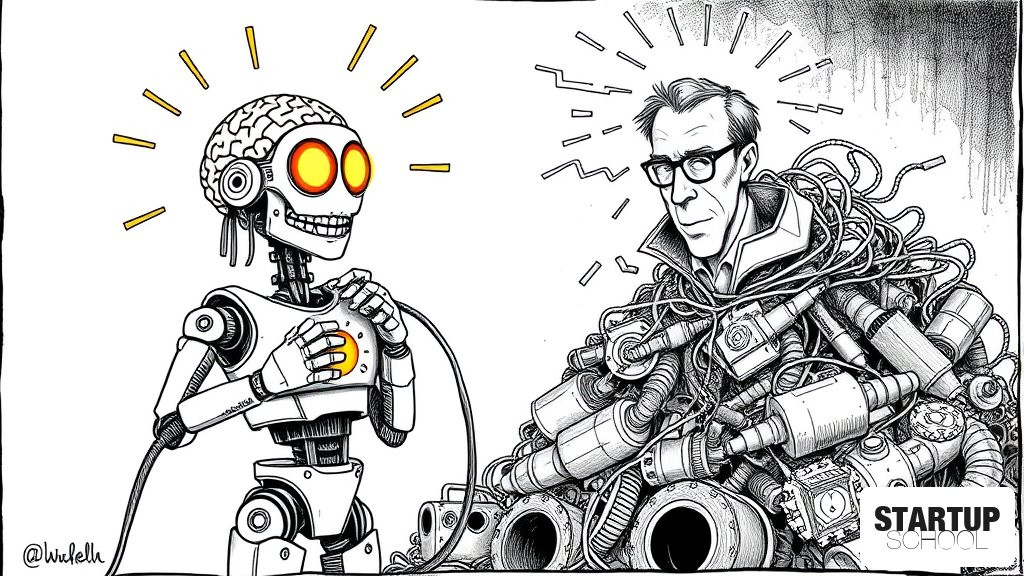

AI 에이전트 개발 시 특정 LLM(GPT, Claude 등)에 종속되지 않도록 설계하는 것이 핵심이다. 프롬프트, 툴 스키마, 파싱 로직 등을 추상화하여 모델 교체 시 발생하는 막대한 기술 부채와 비용을 최소화하는 전략이 필요하다.

이 글의 핵심 포인트

- 1모델 종속의 진짜 원인은 API가 아니라 프롬프트, 툴 스키마, 출력 파서, 파인튜닝, 가격 구조에 있다.

- 2모델 호출을 추상화하여 공급자(Provider)에 관계없이 일관된 입출력을 유지하는 Wrapper 함수를 구축해야 한다.

- 3정규표현식(Regex) 대신 JSON 스키마 기반의 구조화된 출력(Structured Outputs)을 사용하여 모델 교체 시의 파싱 오류를 방지해야 한다.

- 4서비스 안정성을 위해 2~3개의 모델을 연동한 자동 폴백(Fallback) 패턴을 도입하여 장애 및 성능 저하에 대비해야 한다.

- 5모델 출시 때마다 성능 변화를 즉각 감지할 수 있는 50~100개 규모의 자동화된 평가(Eval) 스위트를 운영해야 한다.

이 글에 대한 공공지능 분석

왜 중요한가

LLM 생태계는 모델의 성능과 가격이 매우 빠르게 변하는 역동적인 시장이다. 특정 모델에 과도하게 최적화된 에이전트는 새로운 고성능 모델이 출시되었을 때 즉각적인 대응을 불가능하게 만들어, 제품의 경쟁력을 급격히 떨어뜨린다.

배경과 맥락

현재 AI 개발자들은 모델의 API를 사용하는 것을 넘어, 모델마다 상이한 프롬프트 구조(XML vs JSON), 툴 호출(Function Calling) 규격, 출력 패턴의 차이로 인해 '모델 락인(Model Lock-in)' 현상을 겪고 있다. 이는 단순한 코드 수정을 넘어 서비스 로직 전체를 재구축해야 하는 리스크를 초래한다.

업계 영향

모델 교체에 수개월이 걸리는 팀과 단 며칠 만에 완료하는 팀의 격차는 제품 출시 속도(Time-to-Market)에서 결정적인 차이를 만든다. 이는 향후 에이전트 개발 방식이 단일 모델 중심에서 멀티 모델 및 추상화 레이어 중심으로 이동할 것임을 시사한다.

한국 시장 시사점

글로벌 LLM을 기반으로 서비스를 구축하는 한국 스타트업들에게 '모델 불가지론적(Model-agnostic)' 설계는 생존 전략이다. 비용 효율적인 모델(예: GPT-4o mini)과 고성능 모델(예: Claude Opus)을 상황에 따라 유연하게 스위칭할 수 있는 인프라 구축이 필수적이다.

이 글에 대한 큐레이터 의견

스타트업 창업자들은 '모델의 성능' 그 자체보다 '모델 교체의 용이성'에 더 큰 가치를 두어야 한다. 많은 팀이 특정 모델의 성능을 극대화하기 위해 프롬프트에 모델 특화 문법을 집어넣는 실수를 범하는데, 이는 미래의 기술 부채를 쌓는 행위다. 모델이 바뀔 때마다 서비스 품질을 검증할 수 있는 자동화된 평가(Eval) 파이프라인이 없다면, 기술적 우위는 순식간에 사라질 수 있다.

실행 가능한 인사이트로서, 개발 초기 단계부터 모델 호출을 추상화하는 Wrapper 함수를 구축하고, 정규표현식 대신 JSON 스키마 기반의 구조화된 출력을 사용하는 표준을 세워야 한다. 또한, 서비스 안정성을 위해 2~3개의 모델을 연동한 '자동 폴백(Fallback) 패턴'을 도입하여 특정 공급자의 장애나 가격 변동에 즉각 대응할 수 있는 회복 탄력성을 확보해야 한다.

관련 뉴스

댓글

아직 댓글이 없습니다. 첫 댓글을 남겨보세요.