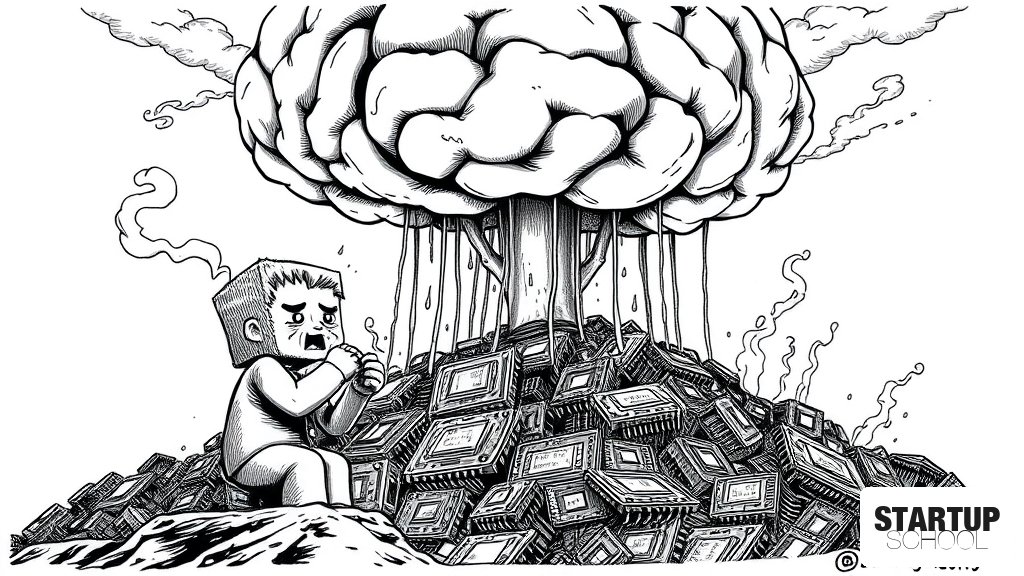

Minecraft에 로컬 Qwen 35B를 실행해 봤더니 제작법을 익혔다 (3,562번의 AI 연산 비용을 지불하며)

(dev.to)

클라우드 API 없이 로컬 환경에서 Qwen 35B 모델을 활용해 마인크래프트 자율 에이전트 'Kiwi-chan'을 구동한 실험 결과, 47.2%라는 유의미한 작업 성공률을 기록했습니다. 이는 API 비용과 속도 제한(Rate Limit)으로부터 자유로운 로컬 LLM 기반 에이전트가 복잡한 물리 환경에서도 자가 학습 및 회복 능력을 갖출 수 있음을 보여줍니다.

이 글의 핵심 포인트

- 1Qwen 35B 로컬 실행을 통해 3,562번의 액션 중 47.2%(1,682건)의 성공률 달성

- 2클라우드 API의 Rate Limit 및 토큰 비용(Token Billing) 문제 완전 해결

- 3로컬 추론을 통한 네트워크 지연 시간 제거 및 프라이빗한 상태 관리(State Management) 구현

- 4실패 사례(로그, 바이옴 불일치 등)를 실시간으로 학습하여 환경 모델을 구축하는 구조

- 5컨텍스트 윈도우 한계 극복을 위한 'Mind Reading' 폴백 메커니즘 적용

이 글에 대한 공공지능 분석

왜 중요한가

기존의 LLM 에이전트들이 클라우드 API의 비용과 지연 시간(Latency) 문제로 인해 고빈도 작업 수행에 한계를 보였던 반면, 로컬 LLM을 통한 '무제한 반복(Unbounded Iteration)' 가능성을 입증했기 때문입니다. 이는 에이전트가 실패를 통해 스스로 학습하는 '자율적 루프'를 비용 효율적으로 구축할 수 있음을 의미합니다.

배경과 맥락

최근 AI 에이전트 분야는 단순한 텍스트 생성을 넘어, 코드를 실행하고 환경과 상호작용하는 '자율적 에이전트(Autonomous Agents)'로 진화하고 있습니다. 이 과정에서 발생하는 막대한 토큰 비용과 네트워크 의존성은 에이전트의 실시간 상호작용을 저해하는 핵심 병목 구간으로 지목되어 왔습니다.

업계 영향

로컬 LLM의 활용은 에이전트의 '프라이버시 강화'와 '비용 구조 혁신'을 동시에 가져올 수 있습니다. 특히 데이터 보안이 중요한 기업용(B2B) 에이전트 시장이나, 실시간 반응이 필수적인 로보틱스, 게임 AI 분야에서 로컬 추론 기반 에이전트의 가치가 급격히 상승할 것입니다.

한국 시장 시사점

고성능 GPU 인프라를 확보하기 어려운 한국 스타트업들에게, 거대 모델(GPT-4 등)에 의존하기보다 Qwen과 같은 고효율 오픈소스 모델을 로컬/엣지 환경에 최적화하여 특정 도메인(Vertical)에 특화된 에이전트를 개발하는 전략이 강력한 경쟁력이 될 수 있습니다.

이 글에 대한 큐레이터 의견

이번 사례는 AI 에이전트 개발의 패러다임이 '모델의 크기'에서 '시스템의 아키텍처'로 이동하고 있음을 시사합니다. 작성자는 단순히 모델을 돌린 것이 아니라, 실패 로그를 컨텍스트에 피드백하고, 컨텍스트 한계 시 'Mind Reading'과 같은 폴백(Fallback) 메커니즘을 설계했습니다. 이는 스타트업 창업자들이 LLM의 성능에만 매몰될 것이 아니라, 에이전트의 '회복 탄력성(Resilience)'을 위한 시스템 설계에 집중해야 함을 보여주는 핵심적인 인사이트입니다.

창업자 관점에서 가장 주목해야 할 기회는 '비용의 비선형적 감소'입니다. API 기반 에이전트는 사용자가 늘수록 비용이 선형적으로 증가하지만, 로컬/엣지 기반 에이전트는 인프라 구축 후 운영 비용을 극적으로 낮출 수 있습니다. 다만, 로컬 추론을 위한 하드웨어 최적화와 모델 경량화 기술(Quantization 등)이 여전히 기술적 진입장벽으로 존재하므로, 이를 해결할 수 있는 엔지니어링 역량이 곧 기업의 핵심 경쟁력이 될 것입니다.

관련 뉴스

댓글

아직 댓글이 없습니다. 첫 댓글을 남겨보세요.