LLM은 더 높은 수준의 추상화가 아니다

(lelanthran.com)

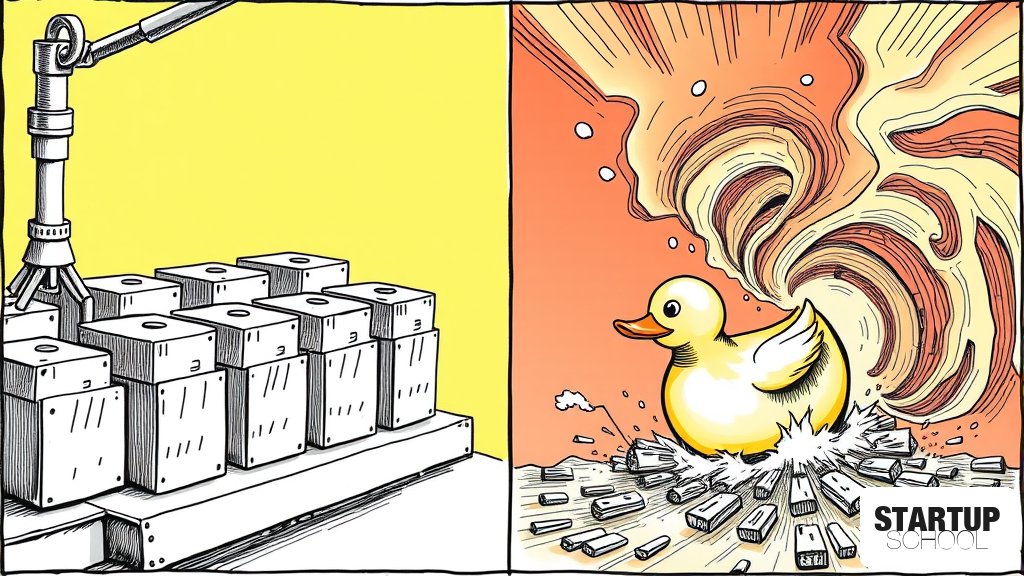

이 기사는 LLM이 C나 Python과 같은 기존 프로그래밍 언어의 '더 높은 수준의 추상화'라는 주장을 정면으로 반박합니다. 기존 언어는 입력값에 대해 결정론적인 결과(f(x) -> y)를 보장하지만, LLM은 확률적 결과(f(x) -> P(y))를 생성하며 의도하지 않은 부작용(z)을 포함할 위험이 있다는 점을 지적합니다.

이 글의 핵심 포인트

- 1LLM은 기존 프로그래밍 언어(C, Python 등)와 같은 수준의 추상화 계층이 아님

- 2전통적 언어는 입력(x)에 대해 결정론적 결과(y)를 보장하지만, LLM은 확률적 결과(P(y))를 생성함

- 3LLM의 출력에는 요청하지 않은 의도치 않은 결과물(z1, z2...)이 포함될 위험이 존재함

- 4테스트 통과 여부와 상관없이 보안 취약점(예: 자격 증명 노출)이 생성될 수 있는 구조적 결함 지적

- 5개발자는 AI의 결과물을 수동적으로 수용하는 채널이 아닌, 비판적 검증 능력을 갖춘 주체가 되어야 함

이 글에 대한 공공지능 분석

왜 중요한가

LLM을 단순한 코딩 도구로 치부하는 낙관론 뒤에 숨겨진 '비결정론적(Non-deterministic) 위험'을 기술적으로 규명했기 때문입니다. 소프트웨어의 신뢰성이 핵심인 엔지니어링 관점에서, 예측 불가능한 코드가 생성될 수 있다는 사실은 시스템의 안정성과 보안에 직면한 근본적인 위협입니다.

배경과 맥락

현재 개발 생태계는 '자연어로 코딩하는 시대'가 도래했다며 LLM을 새로운 추상화 계층으로 정의하려는 흐름이 강합니다. 하지만 전통적인 컴파일러나 인터프리터는 입력에 대해 동일한 바이너리를 생성하는 반면, LLM은 확률 분포를 기반으로 토큰을 생성하므로 논리적 연속성이 끊어지는 지점이 존재합니다.

업계 영향

LLM이 생성한 코드를 검증 없이 도입할 경우, 테스트 케이스를 통과하더라도 의도치 않은 보안 취약점(예: 권한 노출, 백도어)이 포함될 가능성이 큽니다. 이는 소프트웨어 개발 생명주기(SDLC)에서 '검증(Verification)'과 '감사(Auditing)'의 난이도를 급격히 높이는 결과를 초래합니다.

한국 시장 시사점

AI를 활용해 빠른 MVP(최소 기능 제품) 개발을 지향하는 한국 스타트업들에게는 양날의 검이 될 수 있습니다. 개발 속도는 빨라질 수 있으나, 생성된 코드의 '부수적 효과(Side effects)'를 제어할 수 있는 자동화된 테스트 및 보안 검증 인프라 구축이 차세대 기술 경쟁력의 핵심이 될 것입니다.

이 글에 대한 큐레이터 의견

스타트업 창업자들에게 LLM은 분명히 강력한 생산성 도구이지만, 이를 '추상화된 언어'로 오해하는 순간 기술적 부채의 늪에 빠질 수 있습니다. 기사가 지적하듯, LLM의 출력값에는 우리가 요청하지 않은 'z(의도치 않은 코드)'가 포함될 확률이 항상 존재합니다. 이는 단순한 버그를 넘어, 서비스의 근간을 흔드는 보안 사고로 이어질 수 있는 치명적인 리스크입니다.

따라서 창업자는 'LLM으로 얼마나 빨리 만드느냐'보다 'LLM이 만든 결과물의 무결성을 어떻게 보장하느냐'에 더 집중해야 합니다. LLM 기반의 코드 생성 프로세스에 '결정론적 검증 레이어(Deterministic Verification Layer)'를 구축하는 것이 중요합니다. 즉, 확률적인 LLM의 출력을 다시 결정론적인 규칙(Linter, Static Analysis, Unit Test)으로 필터링하는 파이프라인을 설계하는 것이 AI 시대의 진정한 엔지니어링 역량이 될 것입니다.

관련 뉴스

댓글

아직 댓글이 없습니다. 첫 댓글을 남겨보세요.