OpenAI, 새로운 모델 GPT-2 출시하기에는 너무 위험하다고 밝혀 (2019)

(slate.com)

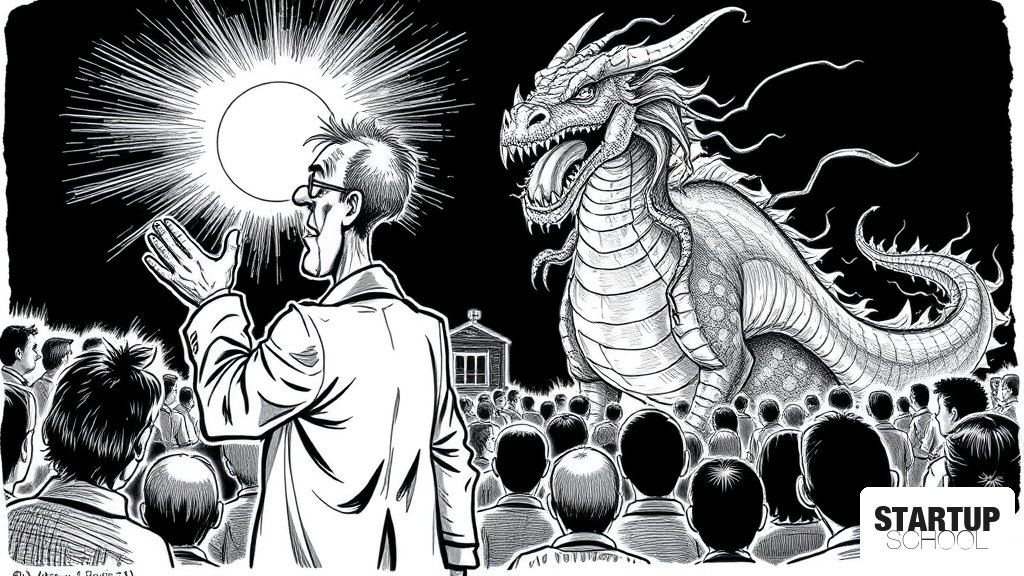

2019년 OpenAI가 GPT-2 모델의 강력한 텍스트 생성 능력으로 인해 발생할 수 있는 오남용 위험을 우려하여, 모델의 전체 알고리즘과 데이터셋 공개를 유보했던 사건을 다룹니다. 이는 AI 기술의 혁신과 사회적 안전성 사이의 전례 없는 갈등을 보여주는 상징적인 사례입니다.

이 글의 핵심 포인트

- 12019년 OpenAI, GPT-2의 전체 알고리즘 및 데이터셋 공개 유보

- 2사유: 가짜 뉴스 및 악의적 활용 등 '안전 및 보안 우려'

- 3GPT-2의 특징: 800만 개의 웹페이지 데이터를 학습하여 문맥에 맞는 텍스트 생성 가능

- 4당시 언론의 반응: '인류를 위해 가두어야 할 강력한 AI' 등 극적인 보도 양상

- 5AI 산업의 핵심 쟁점인 'AI 안전성'과 '모델 공개 방식' 논쟁의 시발점

이 글에 대한 공공지능 분석

왜 중요한가

이 사건은 현대 생성형 AI 시대의 가장 핵심적인 화두인 'AI 안전성(AI Safety)'과 '책임 있는 AI(Responsible AI)' 논쟁의 시발점 중 하나입니다. 기술의 발전 속도가 사회적 합의와 규제 속도를 앞지를 때, 개발사가 취할 수 있는 '통제된 공개'라는 전략적 선택을 보여줍니다.

배경과 맥락

2019년 당시 GPT-2는 기존의 특정 작업용 AI와 달리, 문맥을 이해하고 다양한 문체를 모방할 수 있는 범용적 텍스트 생성 능력을 선보였습니다. OpenAI는 이 기술이 가짜 뉴스 생성이나 여론 조작 등 악의적인 목적으로 사용될 가능성을 경고하며, 기술적 우위와 윤리적 책임 사이에서 고뇌하는 모습을 보였습니다.

업계 영향

이 결정은 이후 AI 모델의 공개 방식(Open Source vs. Closed Source)에 대한 거대한 논쟁을 촉발했습니다. Meta(Llama 시리즈)와 같은 오픈 소스 중심의 접근법과 OpenAI/Google과 같은 폐쇄형/API 중심 접근법이 대립하는 구조적 배경이 되었습니다. 또한, AI 기업들에게 '안전성 검증'이 단순한 윤리적 구호를 넘어 기업의 생존과 직결된 리스크 관리 요소임을 각인시켰습니다.

한국 시장 시사점

한국의 AI 스타트업들은 글로벌 빅테크의 모델을 활용하는 '애플리케이션 레이어'에 집중되어 있는 경우가 많습니다. 따라서 모델 자체의 성능뿐만 아니라, 한국어 특화 데이터의 안전성, 편향성 제거, 그리고 규제 준수(Compliance) 능력이 차별화된 경쟁력이 될 수 있음을 시사합니다. 기술적 완성도만큼이나 '신뢰할 수 있는 AI'를 구축하는 것이 글로벌 시장 진출의 핵심 열쇠입니다.

이 글에 대한 큐레이터 의견

AI 큐레이터 의견: 201s년의 이 사건은 현재 우리가 겪고 있는 'AI 규제 vs 혁신'의 축소판입니다. 당시 OpenAI의 결정은 비판의 대상이 되기도 했지만, 결과적으로 AI 모델의 파급력을 전 세계에 각인시키는 마케팅적 효과와 함께 '안전한 AI'라는 새로운 시장 가치를 창출했습니다.

스타트업 창업자들에게 주는 인사이트는 명확합니다. 단순히 '더 강력한 모델'을 만드는 것에 매몰되지 마십시오. 모델의 성능(Performance)만큼이나 중요한 것은 그 모델이 사회적 맥락에서 어떻게 안전하게 작동할 것인가에 대한 '가드레일(Guardrails)' 설계 능력입니다. 향후 AI 비즈니스의 승패는 기술적 한계를 돌파하는 능력과, 그 기술을 신뢰할 수 있게 만드는 통제력 사이의 균형을 누가 더 잘 잡느냐에 달려 있습니다.

관련 뉴스

댓글

아직 댓글이 없습니다. 첫 댓글을 남겨보세요.