Orbix AI-SPM: AI 시스템을 위한 런타임 보안

(dev.to)

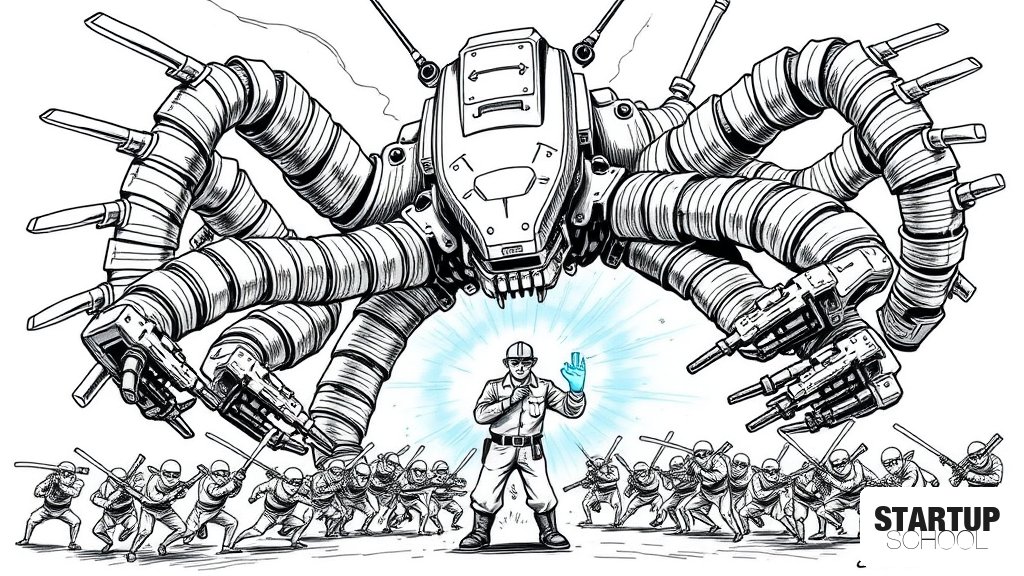

Orbix AI-SPM은 AI 시스템을 단순한 모델이 아닌 에이전트, 도구, 메모리가 결합된 복합 분산 시스템으로 정의하고, 런타임 단계에서 보안을 제어하는 오픈소스 솔루션입니다. 프롬프트 인젝션, 데이터 유출, 도구 오남용 등 AI 에이전트 환경에서 발생하는 새로운 공격 표면을 방어하기 위해 정책 기반의 실행 제어 레이어를 제공합니다.

이 글의 핵심 포인트

- 1AI 보안 패러다임의 전환: '모델 신뢰'에서 '시스템 통제'로 이동

- 2AI 에이전트의 새로운 공격 표면 대응: 프롬프트 인젝션, RAG 오염, 도구 오남용 방지

- 3이벤트 기반 아키텍처: Kafka를 활용한 모든 AI 활동의 추적성 및 감사 기능 확보

- 4정책 기반 실행 제어: Open Policy Agent(OPA)를 통한 동적 권한 관리(Allow/Escalate/Block)

- 5검증된 방어 성능: Garak 레드팀 도구 테스트를 통해 기존 시스템 대비 강력한 보안성 입증

이 글에 대한 공공지능 분석

왜 중요한가

AI 애플리케이션이 단순 챗봇을 넘어 도구를 사용하고 스스로 판단하는 '에이전트' 형태로 진화함에 따라, 기존의 정적 가드레일만으로는 대응할 수 없는 새로운 보안 위협이 급증하고 있습니다. Orbix AI-SPM은 보안의 초점을 '모델의 신뢰'에서 '시스템의 통제'로 전환하여 실질적인 런타임 방어 체계를 제시합니다.

배경과 맥락

최근 AI 기술은 RAG(검색 증강 생성), 외부 API 호출, 장기 메모리 활용 등 복잡한 파이프라인을 포함하는 시스템 아키텍처로 발전했습니다. 이 과정에서 프롬프트 인젝션을 통한 권한 상승, RAG 데이터 오염, 도구 실행 권한 탈취 등 기존 보안 체계가 놓치고 있는 'AI 노출(AI Exposure)' 문제가 핵심 과제로 부상했습니다.

업계 영향

AI-SPM(AI 보안 태세 관리)이라는 새로운 보안 카테고리의 등장을 예고합니다. 기업들은 이제 모델 자체의 성능뿐만 아니라, AI 에이전트가 사용하는 도구와 데이터 흐름을 실시간으로 감시하고 정책(OPA 등)에 따라 실행을 차단하거나 승인하는 '컨트롤 플레인' 구축을 필수적인 인프라로 고려해야 합니다.

한국 시장 시사점

글로벌 수준의 AI 규제가 강화되는 상황에서, 한국의 AI 스타트업들은 제품 개발 초기 단계부터 'Security by Design'을 적용해야 합니다. 특히 기업용(B2B) AI 솔루션을 개발하는 국내 기업들에게 Orbix와 같은 런타임 보안 레이어의 도입은 고객사(엔터프라이즈)의 신뢰를 확보하고 데이터 거버넌스를 증명할 수 있는 강력한 차별화 요소가 될 것입니다.

이 글에 대한 큐레이터 의견

AI 에이전트 시대의 보안은 더 이상 '모델이 얼마나 똑똑한가'의 문제가 아니라 '시스템을 얼마나 정교하게 통제할 수 있는가'의 문제입니다. 많은 창업자가 LLM의 성능과 프롬프트 엔지니어링에 집중할 때, Orbix AI-SP점은 인프라 수준에서의 '실행 제어(Runtime Enforcement)'라는 핵심적인 빈틈을 짚어내고 있습니다. 이는 AI 서비스의 안정성을 결정짓는 결정적인 기술적 해자(Moat)가 될 수 있습니다.

스타트업 창업자들은 주목해야 합니다. 에이전트 기반의 AI 서비스를 구축할 때, 보안을 단순히 '입력값 필터링' 수준으로 생각한다면 이는 잠재적인 보안 폭탄을 안고 가는 것과 같습니다. Orbix가 보여준 것처럼 Kafka를 통한 이벤트 추적, OPA를 활용한 동적 정책 집행, 도구 사용의 스코핑(Scoping) 등 시스템 아키텍처 수준에서의 보안 설계가 병행되어야만 엔터프라이즈급 AI 서비스를 완성할 수 있습니다. 보안을 비용이 아닌, 서비스의 지속 가능성을 위한 핵심 기능으로 재정의해야 할 시점입니다.

관련 뉴스

댓글

아직 댓글이 없습니다. 첫 댓글을 남겨보세요.