Show HN: 파이 4에서 AI 도구 호출을 통해 하드웨어를 제어하는 로컬 LLM

(github.com)

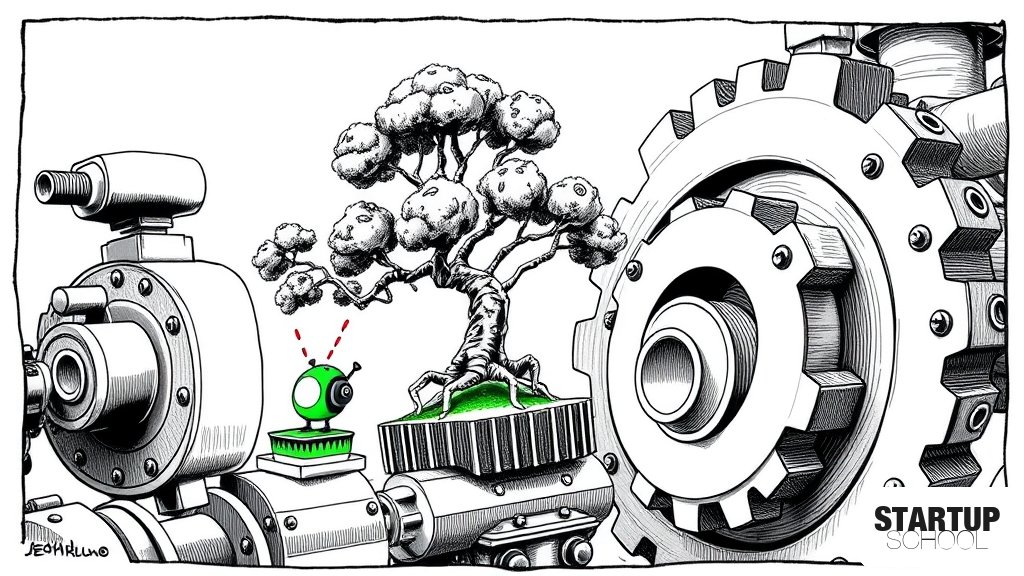

라즈베리 파이 4(4GB)와 초경량 1-bit 양자화 모델인 'Bonsai'를 활용하여 저사양 하드웨어에서도 구동 가능한 로컬 AI 서버 구축 방법을 소개합니다. 이 프로젝트는 보안성이 높은 개인용 LLM 환경을 구축할 뿐만 아니라, LLM의 도구 호출(Tool Calling) 기능을 통해 물리적 하드웨어를 제어하는 엣지 AI의 가능성을 보여줍니다.

이 글의 핵심 포인트

- 1라즈베리 파이 4(4GB)에서 구동 가능한 초경량 1-bit 양자화 모델(Bonsai) 활용

- 2Bonsai 1.7B 모델 기준 단 0.25GB의 RAM 점유율로 극단적 효율성 달성

- 3OpenAI 호환 API 및 Web UI를 통해 로컬 네트워크 내 멀티 디바이스 접근 지원

- 4LLM의 Tool Calling 기능을 통한 물리적 하드웨어(LED, 디스플레이 등) 제어 가능

- 5SSH 키 인증, HTTPS, UFW 방화벽 등 보안 강화 설정이 포함된 완성도 높은 구축 가이드

이 글에 대한 공공지능 분석

왜 중요한가

배경과 맥락

업계 영향

한국 시장 시사점

이 글에 대한 큐레이터 의견

이 프로젝트는 단순한 취미용 프로젝트를 넘어, 'AI의 물리적 실체화'라는 중요한 화두를 던지고 있습니다. 많은 AI 스타트업들이 모델의 크기와 성능 경쟁에 매몰되어 있을 때, 이 프로젝트는 '얼마나 작은 자원으로 얼마나 유용한 제어를 수행할 수 있는가'라는 효율성의 가치에 집중하고 있습니다. 특히 LLM이 단순 텍스트 생성을 넘어 LED나 디스플레이 같은 물리적 하드웨어를 직접 제어하는 'Tool Calling' 기능은 엣지 컴퓨팅의 진정한 킬러 앱이 될 수 있습니다.

창업자 관점에서는 두 가지 전략적 접근이 가능합니다. 첫째, 보안과 프라이버시를 극도로 강조하는 니치 마켓(의료, 법률, 국방 등)을 타겟으로 한 'Air-gapped AI' 솔루션 개발입니다. 둘째, 기존의 단순한 IoT 기기에 LLM 인터페이스를 결합하여 사용자 경험을 혁신하는 '지능형 임베디드 서비스'의 구축입니다. 모델의 추론 속도(2~8 tokens/sec)라는 한계는 분명히 존재하지만, 실시간 대화가 아닌 명령 수행 및 상태 모니터링 용도로는 충분히 상용화 가능한 수준임을 주목해야 합니다.

관련 뉴스

댓글

아직 댓글이 없습니다. 첫 댓글을 남겨보세요.