우리의 AI documentation assistant를 위해 RAG를 virtual filesystem으로 대체했습니다.

(mintlify.com)

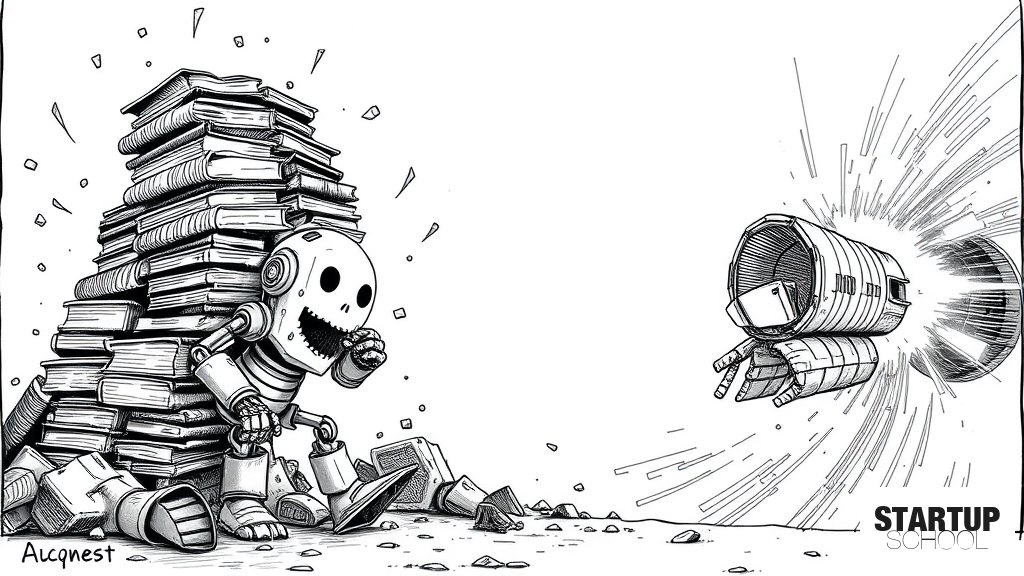

이 기사는 AI 문서 어시스턴트의 RAG(Retrieval Augmented Generation) 한계를 극복하기 위해 가상 파일 시스템 'ChromaFs'를 개발한 과정을 설명합니다. 실제 파일 시스템 샌드박스의 느린 부팅 시간(~46초)과 높은 비용 문제를 해결하고자, 기존 Chroma DB를 활용해 UNIX 명령을 가상으로 처리하며 부팅 시간을 ~100ms로 단축하고 비용을 절감했습니다. 이를 통해 AI 에이전트가 문서를 코드베이스처럼 탐색할 수 있게 되었습니다.

이 글의 핵심 포인트

- 1AI 어시스턴트가 다중 페이지 답변 및 정확한 구문 검색 시 RAG의 한계에 직면했습니다.

- 2실제 파일 시스템을 사용하는 샌드박스는 P90 부팅 시간 ~46초, 연간 컴퓨팅 비용 ~$70,000+ (월 85만 대화 기준)로 비효율적이었습니다.

- 3ChromaFs는 기존 Chroma DB를 활용한 가상 파일 시스템으로, UNIX 명령(grep, cat, ls, find)을 지원합니다.

- 4이 솔루션으로 P90 부팅 시간을 ~46초에서 ~100밀리초로 단축했으며, 대화당 추가 컴퓨팅 비용은 ~$0입니다.

- 5Vercel Labs의 `just-bash` 기반으로 구축되었고, 파일 트리를 gzipped JSON으로 저장하며 세션 토큰 기반의 정교한 접근 제어를 구현합니다.

이 글에 대한 공공지능 분석

왜 중요한가

배경과 맥락

업계 영향

한국 시장 시사점

이 글에 대한 큐레이터 의견

이 ChromaFs 사례는 단순한 기술적 개선을 넘어, AI 에이전트의 작동 방식에 대한 근본적인 철학적 전환을 보여줍니다. 우리는 그동안 AI가 '답변'을 생성하는 데 집중했지만, 이제는 AI가 '탐색'하고 '이해'하는 방식에 주목해야 합니다. 스타트업 창업자들은 여기서 중요한 기회를 포착해야 합니다. 문서, 코드, 데이터베이스 등 기존의 정형/비정형 데이터 소스를 마치 '운영체제'처럼 추상화하여 에이전트에게 제공하는 플랫폼 또는 미들웨어 개발에 뛰어들 수 있습니다. 특히, 이 접근 방식은 'agentic workflow'의 실현 가능성을 크게 높입니다. 사용자가 질문하면 에이전트가 내부적으로 `ls`로 디렉토리를 확인하고, `grep`으로 키워드를 찾고, `cat`으로 내용을 읽어 맥락을 파악한 후, 최종 답변을 생성하는 흐름이 훨씬 자연스러워집니다. 한국 스타트업들은 특정 산업군(예: 법률, 의료, 제조 기술)의 복잡한 전문 문서를 대상으로 이러한 '파일 시스템 기반 AI 에이전트' 솔루션을 개발하여 니치 시장을 공략할 수 있습니다. 기존 RAG의 한계로 인해 불가능했던 정교하고 깊이 있는 정보 탐색 서비스를 제공하는 것이 핵심입니다. 또한, 보안과 권한 관리 측면에서 ChromaFs가 보여준 유연성은 엔터프라이즈 시장에서 큰 강점이 될 것입니다. 각 사용자 그룹별로 접근 가능한 문서 트리를 동적으로 구성하는 기능은 SaaS 기업들이 차등화된 AI 어시스턴트 서비스를 제공하는 데 필수적입니다. 단순히 기술을 도입하는 것을 넘어, 이 새로운 패러다임이 창출하는 비즈니스 모델과 서비스 아이디어를 깊이 탐구하는 것이 성공의 열쇠가 될 것입니다.

관련 뉴스

댓글

아직 댓글이 없습니다. 첫 댓글을 남겨보세요.