자체 LLM을 포기하고 Graviton4 인스턴스에서 오픈소스 Llama 3.2로 전환한 이유: 2026년 비용 및 지연 시간 데이터

(dev.to)

Proprietary LLM(GPT-4 등)에서 AWS Graviton4 기반의 self-hosted Llama 3.2로 전환하여 월간 추론 비용을 약 68% 절감하고, p99 지연 시간을 1.8초에서 620ms로 대폭 개선한 사례를 다룹니다. 성능 저하는 1.2% 미만에 그치며 비용 효율성과 기술적 독립성을 동시에 확보했습니다.

이 글의 핵심 포인트

- 1월간 LLM 추론 비용을 $142,000에서 $45,360로 약 68% 절감

- 2p99 지연 시간을 1.8s에서 620ms로 단축 (GPT-4 Turbo 대비 42% 낮은 지연 시간)

- 312개월 기준 총 소유 비용(TCO)을 $3.94M에서 $1.28M로 67.5% 감소

- 4Llama 3.2 70B(Graviton4) 사용 시 1M 토큰당 비용을 GPT-4 Turbo의 1/3 수준으로 구현

- 52027년까지 기업 LLM 워크로드의 70%가 Arm 기반 클라우드 인스턴스에서 실행될 것으로 전망

이 글에 대한 공공지능 분석

왜 중요한가

배경과 맥락

업계 영향

한국 시장 시사점

이 글에 대한 큐레이터 의견

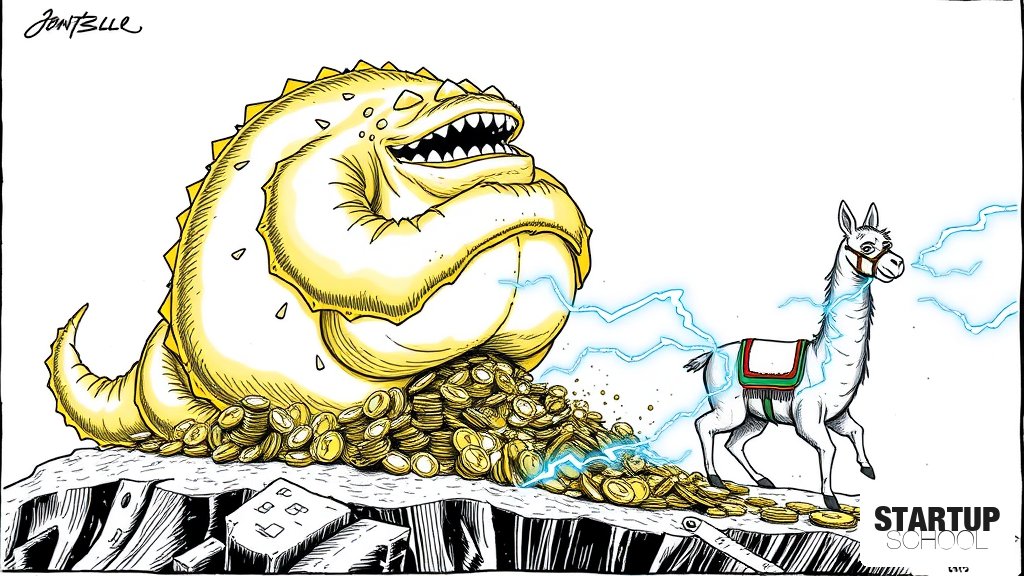

이 사례는 AI 스타트업에게 '모델의 성능'만큼이나 '추론 인프라의 엔지니어링'이 중요하다는 사실을 극명하게 보여줍니다. 많은 창업자가 모델의 파라미터 수나 벤치마크 점수에 매몰되어 있지만, 실제 서비스의 단위당 수익성(Unit Economics)을 결정짓는 것은 결국 토큰당 비용(Cost per 1M tokens)과 지연 시간입니다. Llama 3.2 70B를 Graviton4에서 구동하여 GPT-4 Turbo 대비 1/3의 비용으로 유사한 품질을 구현했다는 점은, 기술적 우위가 곧 가격 경쟁력으로 직결됨을 의미합니다.

다만, 모든 스타트업이 이 경로를 따를 수 있는 것은 아닙니다. 본문에서 보여준 성과는 vLLM과 AWS Neuron SDK를 활용한 고도의 인프라 최적화 역량이 뒷받침되었기에 가능했습니다. 인프라를 직접 관리할 수 있는 엔지니어링 팀이 없는 초기 스타트업에게는 여전히 API 방식이 '속도' 측면에서 유리할 수 있습니다. 따라서 창업자는 서비스 초기에는 API로 빠르게 시장 검증을 하되, 트래픽이 증가하여 비용이 임계점에 도달하는 시점에 맞춰 '자체 호스팅 전환 로드맵'을 반드시 설계해 두어야 합니다.

결론적으로, 앞으로의 AI 경쟁 구도는 '누가 더 똑똑한 모델을 쓰는가'에서 '누가 더 저렴하고 빠르게 모델을 서빙하는가'로 이동할 것입니다. 오픈소스 모델을 활용한 인프라 최적화 기술은 이제 선택이 아닌, AI 비즈니스의 지속 가능성을 결정짓는 핵심 역량이 될 것입니다.

관련 뉴스

댓글

아직 댓글이 없습니다. 첫 댓글을 남겨보세요.