AI 시대를 위해 cache를 재고하는 이유

(blog.cloudflare.com)

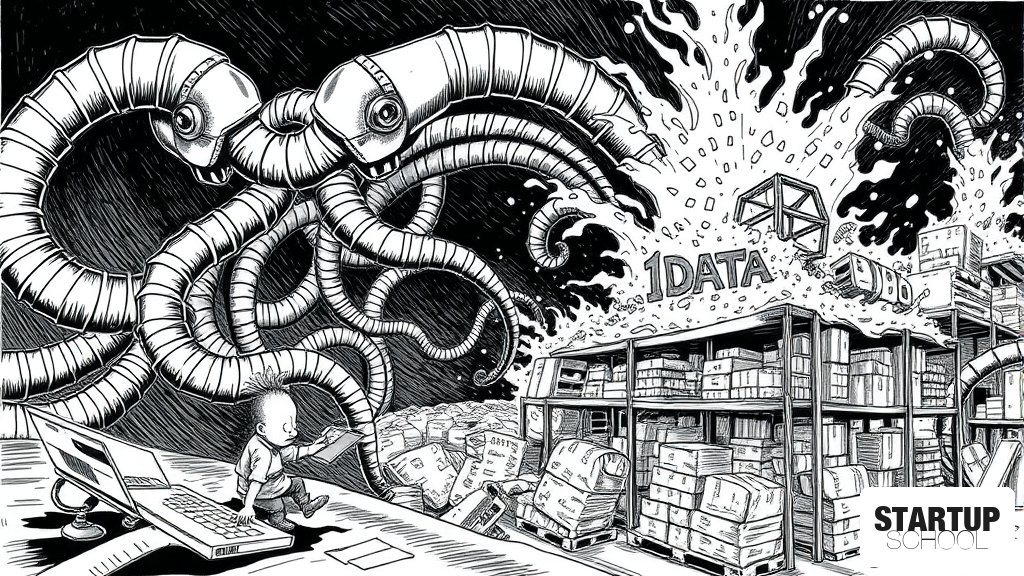

AI 에이전트와 크롤러의 급증으로 인해 기존의 웹 캐시(CDN) 아키텍처가 한계에 직면했습니다. AI 트래픽은 인간의 패턴과 달리 광범위하고 비효율적인 '롱테일' 접근을 특징으로 하며, 이는 서버 자원 관리와 캐시 효율성에 새로운 도전 과제를 던지고 있습니다.

이 글의 핵심 포인트

- 1Cloudflare 네트워크 트래픽의 32%가 자동화된 트래픽(AI 포함)임

- 2AI 크롤러는 높은 고유 URL 비율과 콘텐츠 다양성을 특징으로 하여 캐시 효율을 저하시킴

- 3AI 트래픽은 기존의 '인기 페이지 중심' 캐싱 아키텍처와 충돌하는 패턴을 보임

- 4AI 크롤러의 비효율적 요청(404, 리다이렉트 등)이 캐시 저장소에 부담을 줌

- 5AI 시대에 맞춰 CDN 캐시 설계를 재고해야 한다는 새로운 기술적 패러다임 제시

이 글에 대한 공공지능 분석

왜 중요한가

AI 트래픽이 전체 네트워크 트래객의 32%를 차지할 정도로 급증하면서, 기존의 '인기 페이지 중심' 캐싱 전략이 더 이상 유효하지 않게 되었습니다. AI 크롤러의 비정형적이고 공격적인 데이터 수집 방식은 인프라 비용 상승과 서비스 성능 저하를 초래할 수 있는 핵심 변수입니다.

배경과 맥락

LLM 학습 및 RAG(검색 증강 생성) 기술의 발전으로 AI 에이전트가 웹을 탐색하는 빈도가 높아졌습니다. Cloudflare 데이터에 따르면 AI 크롤러는 단순한 검색 엔진을 넘어, 매우 다양하고 파편화된 URL을 순차적으로 스캔하며 기존 캐시 구조에 부하를 주는 '비효율적' 패턴을 보입니다.

업계 영향

CDN 및 클라우드 인프라 기업들은 인간과 AI 트래픽을 동시에 수용할 수 있는 새로운 캐시 설계 모델을 개발해야 하는 과제를 안게 되었습니다. 웹 서비스 운영자들은 AI 트래픽을 허용하여 AI 검색 결과에 노출을 극대화할 것인지, 아니면 서버 자원 보호를 위해 이를 제한할 것인지에 대한 전략적 선택을 강요받고 있습니다.

한국 시장 시사점

글로벌 시장을 타겟으로 하는 한국의 이커머스, 콘텐츠 플랫폼, SaaS 기업들은 AI 크롤러에 대한 대응 전략을 인프라 수준에서 고민해야 합니다. 'Pay per crawl'과 같은 새로운 수익 모델이나 AI 친지향적인 콘텐츠 구조 설계가 미래의 핵심 경쟁력이 될 수 있습니다.

이 글에 대한 큐레이터 의견

스타트업 창업자들에게 이번 변화는 '인프라 비용 관리'와 'AI 가시성 확보'라는 두 마리 토끼를 잡아야 하는 중대한 변곡점입니다. AI 크롤러의 비효율적인 요청은 캐시 미스를 유발하고 이는 곧 오리진 서버의 부하와 비용 증가로 직결됩니다. 따라서 무조건적인 차단보다는, AI 에이전트가 내 콘텐츠를 효율적으로 읽어갈 수 있도록 구조화된 데이터를 제공하면서도 인프라 비용을 통제할 수 있는 기술적 대응이 필요합니다.

기회 측면에서는 AI 검색 결과(LLM Search)에 자사 서비스가 정확히 노출되도록 하는 'AI SEO' 전략이 중요해질 것입니다. 반면, 위협 측면에서는 예측 불가능한 AI 트래픽 패턴이 서비스 안정성을 해칠 수 있습니다. 따라서 개발팀은 단순한 트래픽 모니터링을 넘어, 트래픽의 성격(Human vs AI)을 식별하고 이에 따라 캐싱 정책을 동적으로 적용할 수 있는 지능적 인프라 전략을 수립해야 합니다.

관련 뉴스

댓글

아직 댓글이 없습니다. 첫 댓글을 남겨보세요.