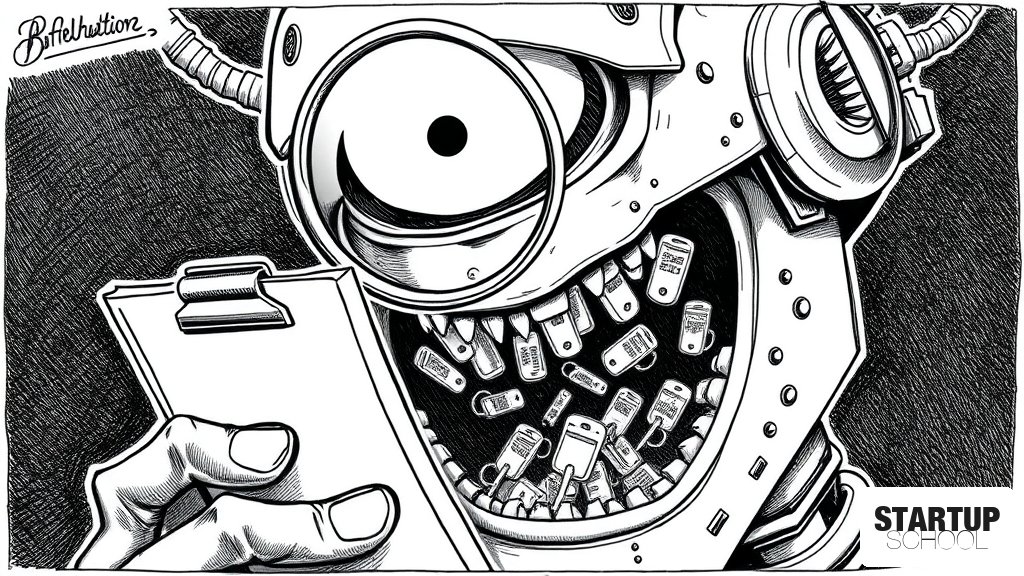

당신의 AI 코딩 어시스턴트가 클립보드를 주시하고 있다: 2026년 비밀 위생 플레이북

(dev.to)

AI 코딩 어식스턴트 사용 중 클립보드에 복사된 API 토큰이나 인증 헤더가 프롬프트에 붙여넣기 되면서 발생하는 새로운 보안 유출 경로를 경고합니다. 기존의 Git 기반 보안 스캐너가 잡아낼 수 없는 '커밋 전 단계'의 보안 공백을 메우기 위한 '클립보드 격리(Quarantine) 패턴'을 대안으로 제시합니다.

이 글의 핵심 포인트

- 1AI 어시스턴트를 통한 보안 유출은 Git 커밋 전, 클립보드 단계에서 발생하여 기존 스캐너를 우회함

- 2주요 유출 경로 4가지: 프롬프트 붙여넣기, 파일 드래그, 모델의 코드 완성 기능, 텔레메트리 로그

- 3개발자의 생산성 향상을 위한 행동(에러 로그 붙여넣기)이 보안 사고의 직접적인 트리거가 됨

- 4해결책으로 '격리(Quarantine) 패턴' 제안: 클립보드 내 민감 정보를 감지하여 별도 보관 및 선택적 붙여넣기 허용

- 5효과적인 보안 도구는 네트워크 호출 없이 로컬에서 빠르게 작동하는 규칙 기반(Regex/Entropy) 형태여야 함

이 글에 대한 공공지능 분석

왜 중요한가?

기존 보안 모델은 코드가 저장소(Repository)에 올라가는 시점을 기준으로 설계되었으나, AI 어시스턴트는 코드가 커밋되기도 전인 '클립보드' 단계에서 데이터를 외부로 유출시킵니다. 이는 개발자의 생산성을 높이려는 시도가 의도치 않게 기업의 핵심 자산을 유출하는 새로운 공격 벡터가 될 수 있음을 의미합니다.

어떤 배경과 맥락이 있나?

GitHub Copilot, Cursor 등 LLM 기반 코딩 도구의 확산으로 개발자들은 에러 로그나 설정 파일을 AI에 그대로 붙여넣는 작업이 일상화되었습니다. 이 과정에서 인증 토큰, 환경 변수 등이 포함된 텍스트가 AI 모델 제공자의 서버와 로그에 기록되는 '보이지 않는 유출'이 발생하고 있습니다.

업계에 어떤 영향을 주나?

보안 솔루션의 패러다임이 '레포지토리 스캔'에서 '로컬 개발 환경 및 클립보드 감시'로 이동해야 하는 압박을 받게 될 것입니다. 보안 도구는 개발자의 워크플로우를 방해하지 않으면서도, 클립보드 내의 민감 정보를 식별하고 격리하는 로컬 기반의 가벼운 에이전트 형태로 진화할 가능성이 높습니다.

한국 시장에 어떤 시사점이 있나?

빠른 제품 출시를 위해 AI 도구를 적극적으로 도입하는 한국 스타트업들에게 이는 심각한 컴플라이언스 리스크입니다. 보안 정책을 단순히 '코드 리뷰'나 'Push 보호'에 국한하지 말고, 개발자의 로컬 환경과 AI 도구 사용 가이드라인에 '클립보드 위생' 항목을 포함하는 선제적 대응이 필요합니다.

이 글에 대한 큐레이터 의견

이 기사는 AI 시대의 보안이 '사후 검증'에서 '사전 차단'으로 이동해야 함을 날카롭게 지적하고 있습니다. 스타트업 창업자 입장에서 AI 어시스턴트는 거부할 수 없는 생산성 도구이지만, 동시에 통제 불가능한 데이터 유출 통로가 될 수 있다는 점을 명심해야 합니다. 특히 '개발자가 의도적으로 정보를 제공하는 행위'가 유출의 핵심이라는 점은 기존의 보안 교육으로는 해결하기 어려운 구조적 문제입니다.

따라서 창업자와 CTO는 개발자에게 '하지 마라'고 강요하기보다는, 기사에서 제안한 '격리(Quument) 패턴'처럼 기술적인 안전장치를 로컬 환경에 구축하는 데 투자해야 합니다. 클립보드에 민감 정보가 감지될 때 이를 별도의 보관함으로 옮기고 명시적 승인을 거치게 하는 방식은 개발 생산성을 유지하면서도 보안 사고를 막을 수 있는 실질적인 실행 전략입니다. 보안을 개발 프로세스의 '방해물'이 아닌 '안전한 가속기'로 만드는 것이 AI 시대 보안 전략의 핵심입니다.

관련 뉴스

댓글

아직 댓글이 없습니다. 첫 댓글을 남겨보세요.