NAT 포트 고갈 문제 해결 실전: 간헐적 타임아웃에서 근본 원인 파악까지

(dev.to)

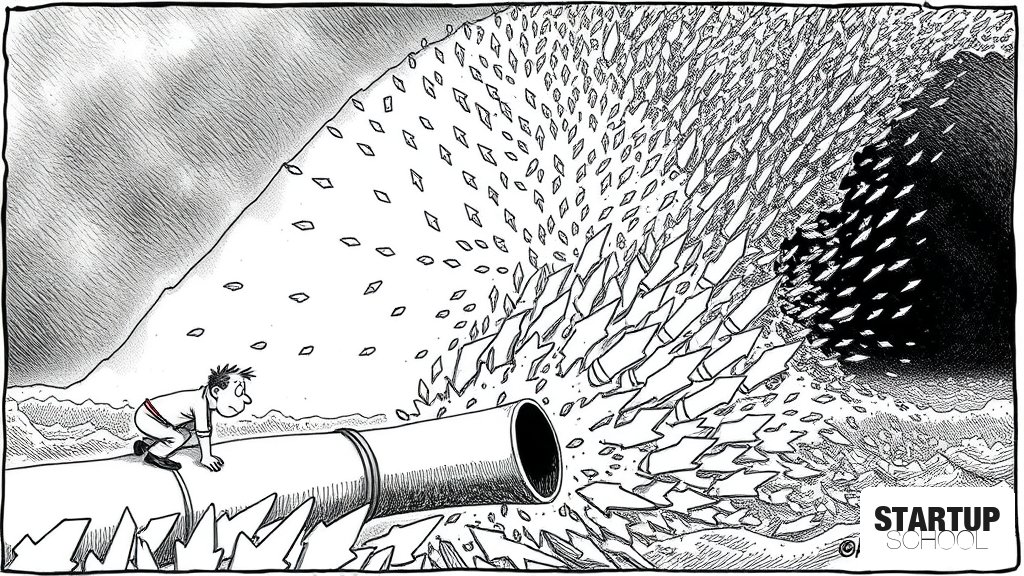

클라우드 환경에서 발생하는 NAT 포트 고갈 문제는 서비스 중단이 아닌 '간헐적 타임아웃'이라는 형태로 나타나 원인 파악이 매우 까다로운 장애입니다. 본 기사는 NAT 포트 고갈의 징후를 식별하는 방법부터, 재시도 폭풍(Retry Storm)과 같은 근본 원인 분석, 그리고 이를 해결하기 위한 연결 관리 및 인프라 최적화 전략을 실무적인 관점에서 제시합니다.

이 글의 핵심 포인트

- 1NAT 포트 고갈은 5xx 에러가 아닌 '연결 단계(SYN/TLS Handshake)의 타임아웃'으로 나타나 식별이 어려움

- 2과도한 짧은 연결(Short-lived connections)과 공격적인 재시도 전략이 포트 고갈을 가속화하는 핵심 원인임

- 3장애 발생 시 내부 통신은 정상이나 외부 API(결제, 인증 등) 호출만 실패하는지 확인하는 것이 첫 번째 단계

- 4해결책으로 NAT 게이트웨이 IP 추가, 연결 풀링(Connection Pooling) 최적화, 서킷 브레이커 도입 등이 필요함

- 5단순 리소스 모니터링을 넘어, 신규 연결 생성률 및 세션 점유율 등 통신 계층의 지표 관리가 필수적임

이 글에 대한 공공지능 분석

왜 중요한가

배경과 맥락

업계 영향

한국 시장 시사점

이 글에 대한 큐레이터 의견

스타트업 창업자와 CTO 관점에서 이 문제는 '기술 부채가 어떻게 서비스 신뢰도를 갉아먹는가'를 보여주는 전형적인 사례입니다. 많은 팀이 트래픽 증가 시 서버 사양을 높이는 데 집중하지만, 정작 병목은 서버 내부가 아닌 서버가 외부와 소통하는 '통로(NAT)'에 있을 수 있습니다. 특히 '재시도(Retry) 로직'이 서비스 안정성을 위한 안전장치가 아니라, 오히려 인프라를 파괴하는 공격 수단이 될 수 있다는 점을 명심해야 합니다.

실행 가능한 인사이트를 드리자면, 첫째로 모니터링의 질을 높여야 합니다. '연결 실패'가 발생할 때 그것이 애플리케이션의 로직 문제인지, 네트워크 계층의 자원 부족인지 즉각 판별할 수 있는 지표(SYN/TLS 핸드셰이크 타임아웃 등)를 확보해야 합니다. 둘째로, 비용 효율적인 해결을 위해 인프라 증설 이전에 '연결 재사용(Connection Pooling)'과 '지수 백오프(Exponential Backoff)'를 적용한 재시도 전략을 최우선으로 검토하십시오. 인프라 확장은 최후의 수단이어야 비용과 운영 복잡도를 줄일 수 있습니다.

관련 뉴스

댓글

아직 댓글이 없습니다. 첫 댓글을 남겨보세요.